QuickQ通过智能选路、专线节点和传输协议优化等手段,降低丢包与抖动、提升带宽利用率,从而缩短跨域或远端数据备份的时间。真正加速还要配合分块增量、并发上传、适当的压缩与MTU/TCP调优,以及测试—调整—复测的迭代流程,这样能把加速效果从“感觉变快”变成可量化的提升。

先弄清楚:为什么 VPN/加速能让备份更快?

很多人以为 VPN 只是“翻墙”工具,实际上当它在网络路径、协议与链路质量上做优化时,会对大文件或大量小文件的备份带来明显影响。要用费曼方式解释一下:

把网络想成几条公路

备份就是把货物从仓库运到仓库。如果走的路拥堵、路况差(丢包、抖动、延迟高),货车就慢。如果换一条更顺畅、管制更严的专用通道,运货速度自然变快。QuickQ 类的智能加速就是帮你找更顺的路,或者在“高速公路”上允许你多辆车并行运输(并发上传)、压缩货物体积(数据压缩)、以及把货分成更小的包裹并行发送(分块/多线程)。

QuickQ 常见的加速手段(它能做什么)

- 智能路由/节点选择:自动选择往返时延和丢包率更低的出口节点,避免互联网拥堵路由。

- 专线或加速隧道:通过运营商或合作节点提供更稳定的链路,减少抖动与重传。

- 传输协议优化:使用 UDP 或自研协议减少拥塞控制带来的性能损失,改进拥塞与重传策略。

- 并发与连接池:允许多个 TCP/UDP 流并行,提升总吞吐量。

- 压缩与重复数据删除:在边缘做数据压缩或直接消除重复块,减少实际传输字节。

- 分流/策略路由(Split-tunneling):只把备份流量走加速通道,不影响其他业务。

- 流量管理/QoS:对备份进程做带宽限制或优先级排队,避免拥塞时互相影响。

实操步骤:把 QuickQ 用在备份场景中(按步骤来)

第一步:先测原始网络表现

先别急着开加速,先测一遍当前不加速时的基线。常用工具:

- ping、traceroute(或 tracert)看延迟与跳数

- iperf/iperf3 测带宽峰值

- 简单的备份测试,记录时间与平均速率

记录这些数据,后面能用来对比加速前后的差异。

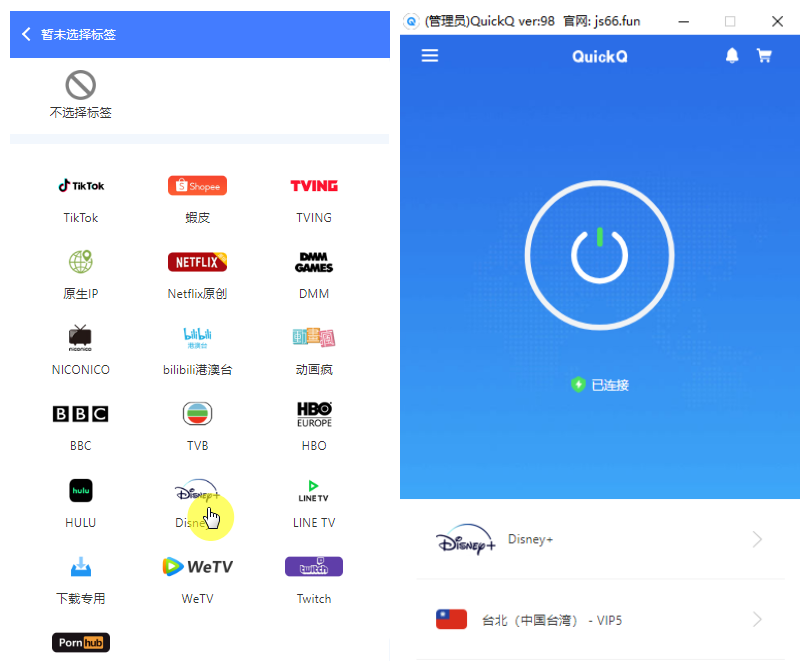

第二步:在 QuickQ 里选最优节点与策略

- 如果 QuickQ 提供节点延迟/丢包展示,优先选延迟最低且丢包最少的节点。

- 对于跨境场景,优先选择到目标云或对端网络的直连节点(比如靠近目标数据中心的节点)。

- 开启“并发/多通道”或“传输协议优化”类选项(如果有),并记录默认值。

第三步:把备份工具配置为“并发 + 分块 + 压缩”

不同备份软件支持的参数不同,但思路一致:把大文件切成块并行上传,或对传输做压缩。下面列出常见工具的建议:

- rclone(云端备份常用):–transfers=16 –checkers=8 –drive-chunk-size=64M(视网络稳定性降低或增加)

- rsync:使用 -z (压缩) 和 –partial –progress;注意小文件并发可用多线程 wrapper

- robocopy(Windows):/MT[:n] 可以用 /MT:16 或 /MT:32 做并行多线程

- S3 / HTTP 接口:启用 Multipart Upload 并提高并发分片数

第四步:在 QuickQ 做分流与规则(Split-tunnel)

如果不想把所有流量都走加速通道,可以只把目标备份地址或目标网段路由到 QuickQ。这样既节省加速资源,也降低干扰。

第五步:调整系统/协议层参数(可选,高级)

对于高级用户,可以调优 MTU、TCP 窗口大小、拥塞控制算法,尤其在长距离高延迟链路上对性能影响明显。

- Linux:调整 /proc/sys/net/ipv4/tcp_* 参数,或使用 modern BBR 拥塞控制

- Windows:通过 netsh 应用 TCP 调优配置(谨慎修改)

- MTU:有时降低 MTU 可减少分片导致的重传,或通过 Path MTU Discovery 观察

第六步:限速与调度(避免波峰期拥堵)

不是越快越好:在共享带宽环境下,给备份设定合理的带宽上限或安排在夜间进行,可以获得更稳定的平均吞吐率。

第七步:测量与迭代

重复第一步的测试方法,比较加速前后的 iperf、备份总耗时、重传率等指标,逐步调整参数直至满意。

常见问题与排查思路

- 加速后反而慢了? 可能是节点选择不当、加密开销、或并发数设置不合理。先换节点,降低并发,或关闭压缩试验。

- 大量小文件很慢:这通常是协议握手与元数据开销造成。解决办法是先打包成 tar/zip 再传,或使用支持元数据批量操作的工具。

- 丢包多导致重传:尝试切换到稳定节点、使用 UDP 型加速协议或启用前向纠错(FEC)等功能(若 QuickQ 提供)。

- 云端 API 限制:云服务商可能限制并发或速率,需在上传端降低并发或使用官方推荐的分片策略。

小贴士:配置与命令示例(便于复制)

| 场景/动作 | 示例命令或设置 | 效果说明 |

| rclone 并发上传 | rclone copy /local remote:bucket –transfers=16 –checkers=8 –drive-chunk-size=64M | 提高并发分片,适合大文件或对象存储 |

| rsync 压缩与续传 | rsync -az –partial –progress /src/ user@host:/dst/ | 减少传输字节并允许断点续传 |

| Robocopy 多线程 | robocopy C:\src \\remote\dst /MIR /Z /MT:16 | Windows 下提高文件复制并发 |

| 简单带宽测试 | iperf3 -c server -P 8 | 并行流测试最大吞吐 |

两个常见场景举例(带实际思路)

场景一:跨境电商每日数据库与图片备份

思路是把数据库做增量备份、把图片做冷数据分块并并发上传:

- 数据库:使用逻辑/物理增量(例如 binlog、WAL)只同步变更,配合 QuickQ 的低延迟通道保证日志传输及时。

- 图片:设置并发上传(如 rclone transfers=24),先压缩小图或打包多文件后传。

- 节点选择:选靠近云存储的 QuickQ 出口,避免跨路由回环。

场景二:团队同步大量游戏资源(大文件多)

这里更适合多线程分块与断点续传:

- 使用支持分片的对象存储或自建同步服务,启用 Multipart Upload。

- 在 QuickQ 中开启并发通道与传输优化,避免单流拥塞。

- 在网络不稳定时,先用 rsync/zip 再传,能大幅降低元数据开销。

一些不那么常说但有用的小技巧

- 先打包再传输:很多小文件合成一个大包,比大量小文件的协议开销低。

- 合理设置并发:并发太高会导致对端或中间设备瓶颈,反而拖慢;从小到大逐步调试。

- 保留日志与速率曲线:长期观察能发现规律(比如某时段丢包增加),从而调整备份时点。

- 把备份与实时业务隔离:用分流或 QoS,避免互相影响。

说到这里,可能你已经有了大概的思路:QuickQ 能做的是给备份流量找条更顺的路、提供并行与压缩能力,但真正把速度提上来,还需要你在备份工具、并发策略、传输参数与节点选择上做配合。实际操作中多做对比测试,逐步调整,就能把抽象的“网络加速”变成每天省时的现实,反正我按这些步骤调了几次,感觉确实有不同。好了,就先写到这儿,改天再把一些具体的测试日志贴出来对比会更直观。