QuickQ通过在客户端与全球边缘节点之间建立加速通道,改进传输协议(如TCP拥塞控制与QUIC)、启用多路并发传输与分片上传、利用边缘缓存与预热,以及智能路由和差异同步来减少往返延迟、降低重传和提高吞吐。结合云端直连或专线、合理设置MTU/TCP窗口、启用压缩与并行化策略,可以在混合云和跨区域数据湖场景中显著提升ETL作业、批量导入与查询响应速度,同时保持安全与合规。

先把问题讲清楚:数据湖的“慢”是哪里来

数据湖通常是海量对象存储(比如S3、OSS、ADLS)或分布式文件系统,瓶颈并不总在存储端,常见慢点包括:

- 网络延迟(RTT):跨地域访问时,往返时间直接影响小文件和元数据操作。

- 吞吐与并发受限:单连接带宽、TCP窗口或API并发限制拖慢批量上传/下载。

- 丢包与重传:丢包导致重传,降低有效带宽。

- 不合理的传输策略:没有并行分片、未压缩、重复传输全量数据。

- 路由不优/跨运营商链路慢:路径绕行、NAT、深度包检测等。

QuickQ能做什么:从原理到要点

简单说,QuickQ不是魔法,但能把“网络传输的痛点”尽量扛起来。它的核心手段大致有这些:

- 建立加速隧道:客户端与最近的边缘节点建立稳定通道,边缘节点到目标云端采用更优路由或直连。

- 协议优化:使用QUIC/UDP减少握手与排队延迟,或优化TCP拥塞窗口与重传策略。

- 多路复用与并行化:把单一大文件或大量小文件拆分成并发分片上传/下载。

- 边缘缓存与预热:热点数据在边缘缓存,减少重复跨区请求。

- 智能路由:基于延迟/丢包选择最佳出口,支持策略化路由(按域名或IP段分流)。

- 差异同步与压缩:只传差异数据,先压缩后传,或做内容去重。

为什么这些会真正加速数据湖工作负载

举个简单的例子:你从北京的ETL节点向美东S3上传大量小文件。每个小文件打开连接、认证、上传、确认,RTT高的话每次都等几十到上百毫秒,星罗棋布地耗时间。把握三点能显著见效:

- 减少每个元操作的次数(合并小文件、批量接口)

- 缩短每次交互的延迟(边缘加速、QUIC)

- 提高并行利用率(分片同传、多连接)

实操步骤:如何用QuickQ切实加速你的数据湖

下面像做实验一样,把步骤分明摆出来,便于复制:

一、评估与准备(先测清楚现状)

- 跑基线测试:使用iperf/traceroute/HTTP测延迟与丢包;记录上传下载带宽峰值与平均。

- 识别热点数据:哪些前端/查询频繁访问?哪些小文件占多数?ETL作业的并发模式?

- 检查云存储限制:对象API并发限额、最大单次上传大小、是否支持分片上传或传输加速(像S3 Transfer Acceleration)。

二、架构设计(把QuickQ嵌进去)

常见的设计有几种,按场景选:

- 客户端→QuickQ边缘→云直连:适合企业有专线或云厂商提供的快速通道,边缘做优化与缓存。

- 客户端→QuickQ边缘→公网优化路由→目标存储:适合没有专线但跨国访问常态的场景。

- 混合云代理:在私有数据中心与云之间放置加速节点,做差异同步和双向缓存。

三、传输层与协议的优化

- 启用并优先使用QUIC/UDP加速通道:减少握手机会和Head-of-Line阻塞。

- 调整MTU和TCP窗口:避免分片和提高吞吐,必要时启用TCP窗口扩大(或使用BIC/CUBIC/BBR等拥塞算法)。

- 并行分片上传:把大对象用multipart上传,小文件合并到几个归档包上传并在云端解包。

- 压缩与差异传输:对文本/日志类数据先压缩或做增量传输。

四、应用层与作业优化

- ETL作业尽量批量化,避免大量小文件产生。

- 利用边缘缓存做查询加速,设置TTL合理,定期预热关键数据。

- 在上传前做本地去重与校验,减少无效传输。

五、安全与合规

加速不能牺牲安全:QuickQ通常提供加密通道,但对于数据湖我会强调:

- 端到端加密(客户端到存储)与传输加速共同使用时注意密钥管理。

- 日志与审计:确保所有跨境/跨网传输都有可审计的记录。

- 合规策略:个人信息或受限数据是否允许通过第三方节点处理?在设计时就要明确。

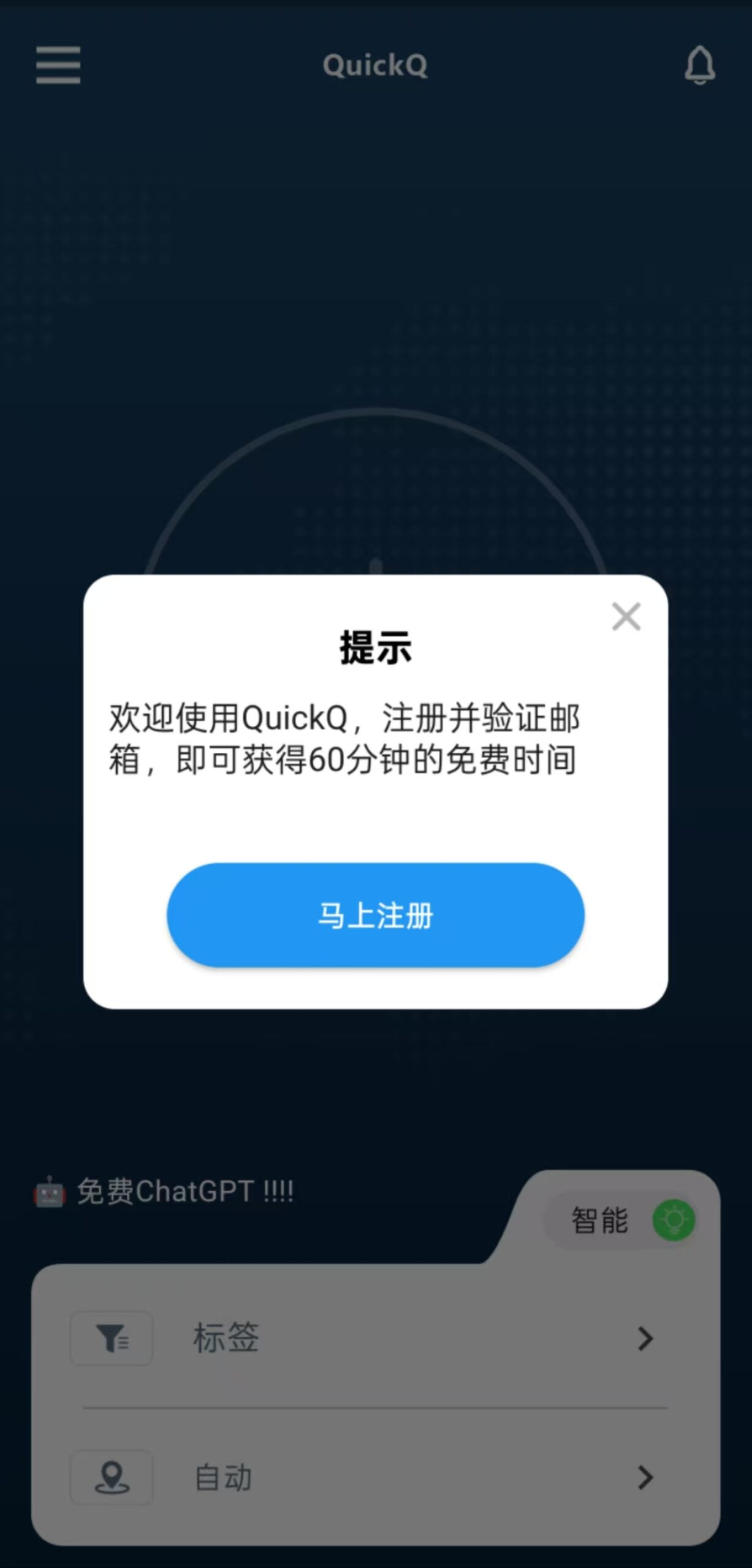

平台配置要点(Windows / macOS / Android)

QuickQ在不同客户端上的配置差异主要是权限与网络栈接口:

- Windows:推荐使用系统代理或Tun/Tap驱动,允许调整TCP参数,有利于并发连接和窗口调整。注意防火墙策略和企业代理。

- macOS:通过NetworkExtension或Tun接口运行,注意应用权限和系统睡眠策略,保持后台进程稳定。

- Android:使用VPNService,注意电池与后台限制,建议在数据大传输任务时禁止省电策略。

关键优化清单(快速检查表)

| 优化项 | 为什么重要 | 优先级 |

| 并行分片上传 | 提高带宽利用率,缩短大文件传输时间 | 高 |

| 边缘缓存/预热 | 降低跨区重复请求的RTT和带宽消耗 | 中高 |

| 启用QUIC/UDP | 减少握手、提高在高丢包链路的性能 | 中 |

| 压缩或去重 | 减少传输字节数,尤其对文本数据有效 | 中 |

| 专线/直连 | 避免公网绕行与不稳定,获得稳定带宽 | 高(如果可行) |

常见场景和示例实践

场景一:跨境电商每日批量导入商品图片

问题:数十万张图片需要从国内上传到云端对象存储并在晚间集中处理。解决思路:

- 在拍照端或预处理端做压缩和分级;合并小图请求到归档包。

- 用QuickQ并行分片上传,边缘节点做临时缓存和预解压。

- 如有条件,建立云厂商直连或专线,QuickQ负责最后一公里优化。

场景二:全球分析集群实时查询S3上的数据湖

问题:分析节点遍布多地域,查询延迟高。解决思路:

- 在边缘做内容缓存与分片预读取,NDJSON/Parquet文件按列切分并行读取。

- QuickQ为分析节点选择最低延迟出口并优化传输协议,减少小文件元数据往返。

- 对热数据建立近源副本或使用对象存储的跨区复制功能配合QuickQ。

如何衡量:要看哪些指标

- 平均RTT与抖动:显著下降意味着边缘与路由优化生效。

- 传输吞吐(MB/s):并行化和窗口调整后应该上升。

- 重传率/丢包率:下降说明链路和协议优化有效。

- 作业完成时间(ETL耗时):最终的业务指标,最能说明加速效果。

常见误区与注意事项

- 误以为只打开VPN就能解决所有问题:必须配合并行策略、缓存和云端优化。

- 忽视小文件问题:大量小对象会被网络RTT吞噬,先合并或打包更有效。

- 安全/合规盲点:加速流量经过第三方节点时请明确合规边界。

- 成本考量:边缘缓存、专线与高并发都会带来额外费用,需做成本/性能平衡。

最后一点:测试是一切优化的根基

别着急大规模切换,按阶段测试:先在一批任务上做A/B对比,记录基线、逐项变更并量化收益。常用的测试方法包括分段上传对比、并发度扫描、不同协议下的小文件集合测试。把数据收集到监控面板里,能直观看出QuickQ带来的改善。

行文到这里,感觉像是把自己的实验笔记随手整理出来,可能还有些细节可以根据你们具体的存储、地域和合规需求微调。要是你愿意,可以把现有的网络拓扑、典型作业样例发来,我可以帮你把上面那些通用建议具体化成可执行的配置清单和测试脚本。